Unternehmen stehen beim Einsatz von KI-Fähigkeiten zur Beschleunigung des Software-Entwicklungszyklus vor einer kritischen Herausforderung: Wie lassen sich KI-Funktionen nutzen und gleichzeitig die Kontrolle über Daten, Infrastruktur und Sicherheitsarchitektur bewahren? GitLab Duo Self-Hosted bietet hierfür eine Lösung. Dieser Artikel beschreibt die Implementierung von GitLab Duo Self-Hosted-Modellen. Der systematische Leitfaden richtet sich an Unternehmen mit strengen Datensouveränitätsanforderungen, die dennoch KI-gestützte Entwicklung nutzen möchten. Der Fokus liegt auf Modellen, die auf AWS Bedrock gehostet werden, anstatt eine LLM-Serving-Lösung wie vLLM einzurichten. Die Methodik lässt sich jedoch auf Modelle übertragen, die im eigenen Rechenzentrum betrieben werden.

Warum GitLab Duo Self-Hosted?

GitLab Duo Self-Hosted ermöglicht die Bereitstellung von GitLabs KI-Fähigkeiten vollständig in der eigenen Infrastruktur – On-Premises, in einer Private Cloud oder in abgesicherten Umgebungen.

Zentrale Vorteile:

- Vollständige Datenkontrolle: Sensibler Code und geistiges Eigentum verbleiben im eigenen Sicherheitsperimeter. Daten verlassen die Umgebung nicht.

- Modellflexibilität: Auswahl aus verschiedenen Modellen für spezifische Leistungsanforderungen und Anwendungsfälle, darunter Anthropic Claude, Meta Llama, Mistral-Familien und OpenAI GPT-Familien.

- Compliance-Konformität: Unterstützung bei der Erfüllung regulatorischer Anforderungen in stark regulierten Branchen, in denen Daten innerhalb spezifischer geografischer Grenzen verbleiben müssen.

- Anpassbarkeit: Konfiguration, welche GitLab Duo-Funktionen welche spezifischen Modelle nutzen – zur Optimierung von Leistung und Kosten.

- Bereitstellungsflexibilität: Deployment in vollständig luftspalt-isolierten Umgebungen, On-Premises oder in abgesicherten Cloud-Umgebungen.

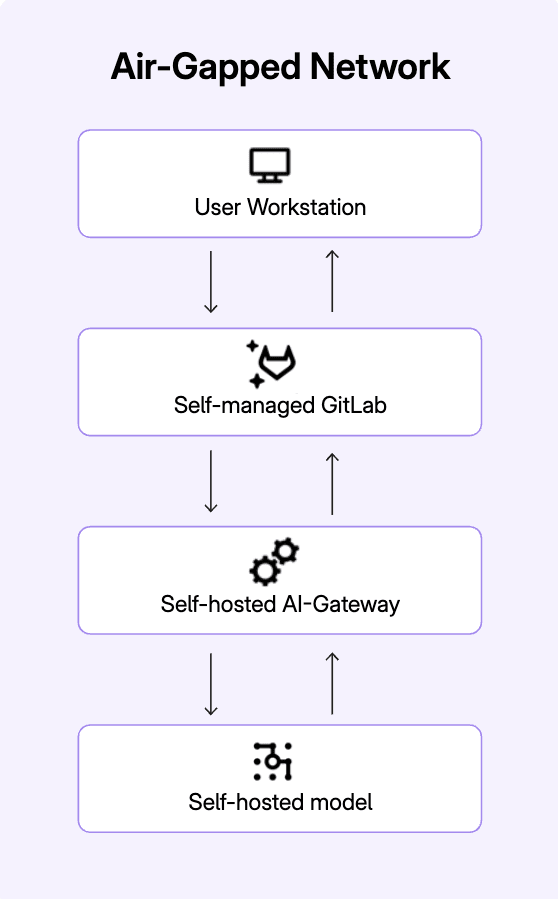

Architektur-Überblick

Die GitLab Duo Self-Hosted-Lösung besteht aus drei Kernkomponenten:

- Self-Managed GitLab-Instanz: Die bestehende GitLab-Instanz, in der Anwenderteams mit GitLab Duo-Funktionen interagieren.

- AI Gateway: Service, der Anfragen zwischen GitLab und dem gewählten LLM-Backend routet.

- LLM-Backend: Der eigentliche KI-Modell-Service – in diesem Artikel AWS Bedrock. Hinweis: Es lässt sich auch eine andere Serving-Plattform verwenden, beispielsweise bei On-Premises-Betrieb oder anderen Cloud-Anbietern.

FÜR COMPLIANCE-VERANTWORTLICHE: Datensouveränität und regulatorische Anforderungen > > GitLab Duo Self-Hosted ermöglicht die vollständige Bereitstellung von KI-Fähigkeiten > in der eigenen Infrastruktur – ohne Datenübertragung an externe Dienste. Dies kann > Unternehmen bei der Erfüllung von Datenschutz- und Compliance-Anforderungen unterstützen. > > Bereitstellungsoptionen für verschiedene Compliance-Level: > - Air-Gapped: Vollständige Netzwerkisolierung für Hochsicherheitsumgebungen (beispielsweise Behörden, Verteidigung, kritische Infrastrukturen) > - On-Premises: vLLM-basierte Bereitstellung für vollständige Infrastrukturkontrolle ohne Cloud-Abhängigkeit > - Private Cloud: AWS Bedrock oder Azure OpenAI, beispielsweise in europäischen Rechenzentren für Hybrid-Szenarien > > Audit-Trails lassen sich über CloudWatch und S3 dokumentieren. > Weitere Informationen: GitLab Duo Self-Hosted Dokumentation > und Datenschutz bei GitLab Duo.

Voraussetzungen

Vor Beginn werden benötigt:

- GitLab Premium- oder Ultimate-Instanz (Version 17.10 oder neuer)

- Empfohlen wird die neueste GitLab-Version, da kontinuierlich neue Funktionen bereitgestellt werden.

- GitLab Duo Enterprise Add-on-Lizenz

- AWS-Konto mit Zugriff auf Bedrock-Modelle oder API-Schlüssel und Zugangsdaten für das eigene LLM-Serving-Modell

Hinweis: GitLab-Neukunden können sich für eine kostenlose Testversion von GitLab Ultimate registrieren, die GitLab Duo Enterprise einschließt.

Implementierungsschritte

1. AI Gateway installieren

Das AI Gateway routet Anfragen zwischen der GitLab-Instanz und der LLM-Serving-Infrastruktur – hier AWS Bedrock. Es lässt sich in einem Docker-Image betreiben. Die Installationsdokumentation beschreibt den Einstieg.

Für dieses Beispiel mit AWS Bedrock müssen AWS Key ID, Secret Access Key und AWS-Region übergeben werden:

AIGW_TAG=self-hosted-v18.1.2-ee docker run -d -p 5052:5052

-e AIGW_GITLAB_URL=<your_gitlab_instance>

-e AIGW_GITLAB_API_URL=https://<your_gitlab_domain>/api/v4/

-e AWS_ACCESS_KEY_ID=$AWS_KEY_ID

-e AWS_SECRET_ACCESS_KEY=$AWS_SECRET_ACCESS_KEY

-e AWS_REGION_NAME=$AWS_REGION_NAME

registry.gitlab.com/gitlab-org/modelops/applied-ml/code-suggestions/ai-assist/model-gateway:$AIGW_TAG

Die AIGW_TAG-Liste zeigt verfügbare Versionen.

In diesem Beispiel wird Docker verwendet. Alternativ lässt sich das Helm-Chart nutzen. Die Installationsdokumentation enthält weitere Informationen.

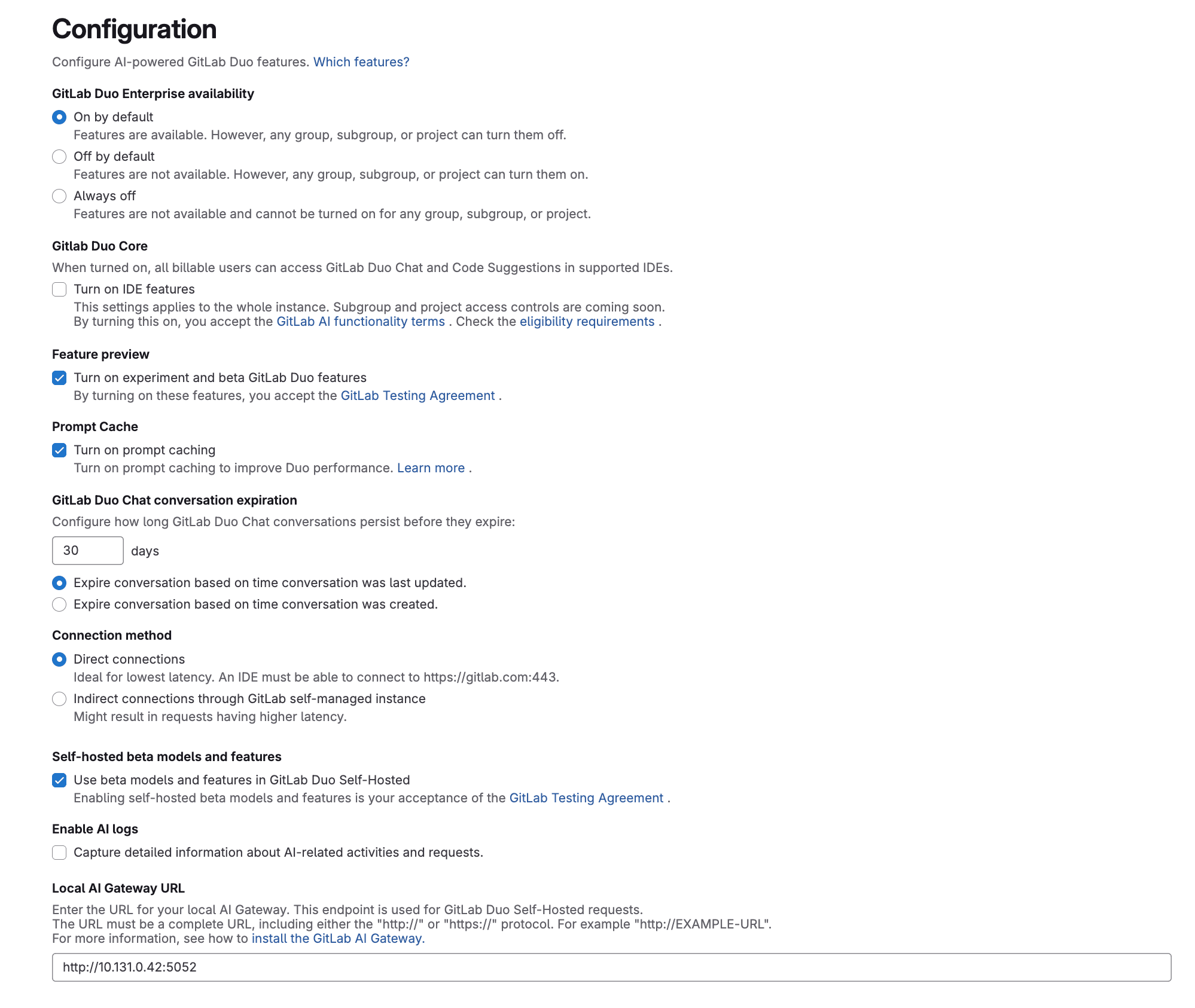

2. GitLab für AI Gateway-Zugriff konfigurieren Nach Start des AI Gateway lässt sich die GitLab-Instanz für dessen Verwendung konfigurieren:

Nach Start des AI Gateway lässt sich die GitLab-Instanz für dessen Verwendung konfigurieren:

- In der linken Seitenleiste unten Admin auswählen

- GitLab Duo auswählen

- Im GitLab Duo-Bereich Change configuration auswählen

- Unter "Local AI Gateway URL" die URL für das AI Gateway und den Port des Containers

eingeben (beispielsweise

https://ai-gateway.example.com:5052) - Save changes auswählen

3. Zugriff auf Modelle von AWS Bedrock anfordern

Als Nächstes wird Zugriff auf die verfügbaren Modelle in AWS Bedrock benötigt:

- Zum AWS-Konto und Bedrock navigieren

- Unter Model access die gewünschten Modelle auswählen und den Anweisungen zum Zugriff folgen

Die AWS Bedrock-Dokumentation enthält weitere Informationen.

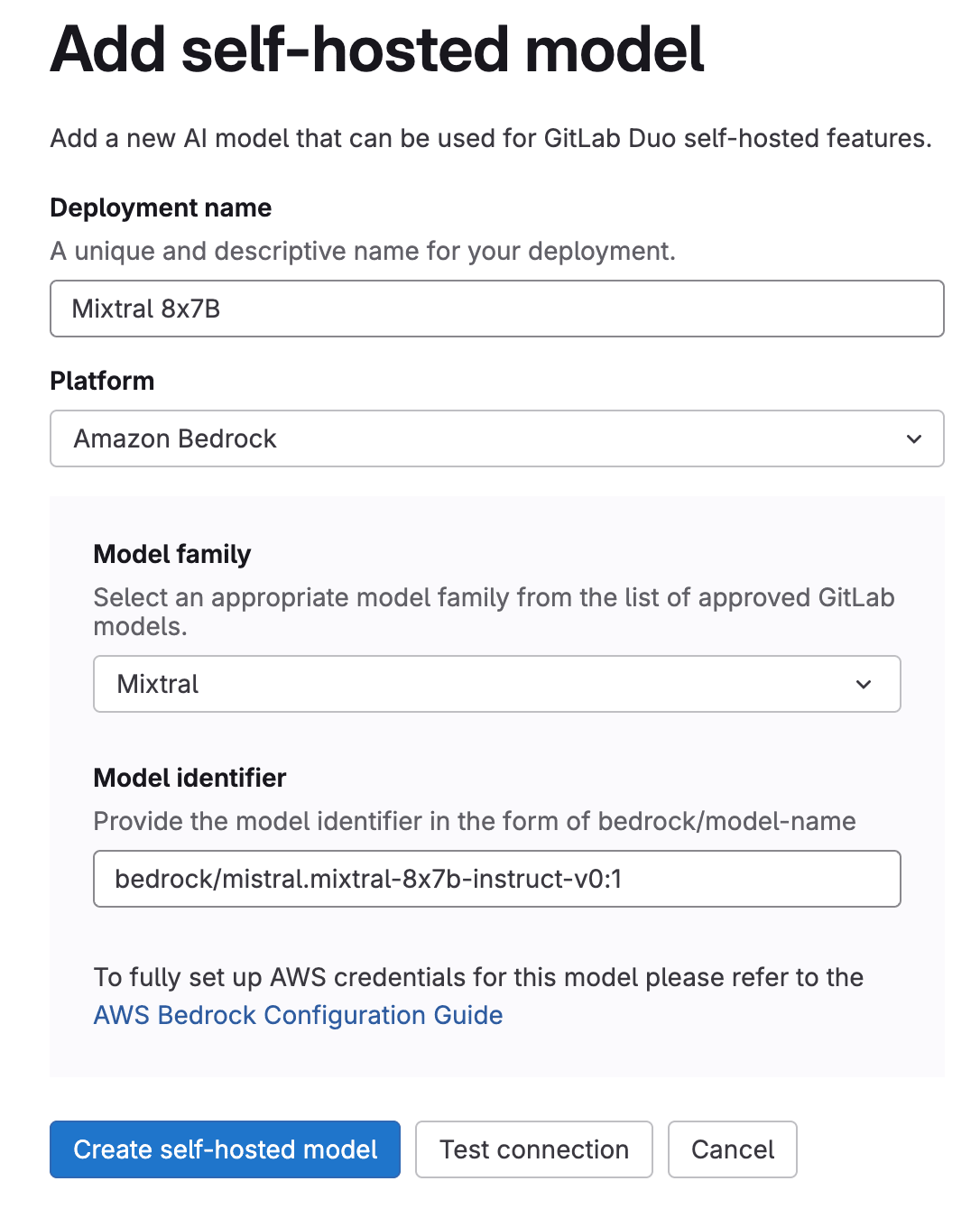

4. Self-Hosted-Modell konfigurieren

Nun lässt sich ein spezifisches AWS Bedrock-Modell für GitLab Duo konfigurieren:

- In der linken Seitenleiste unten Admin auswählen

- GitLab Duo Self-Hosted auswählen

- Add self-hosted model auswählen

- Felder ausfüllen:

- Deployment name: Name zur Identifikation dieser Modellkonfiguration (beispielsweise "Mixtral 8x7B")

- Platform: AWS Bedrock auswählen

- Model family: Modell auswählen, beispielsweise "Mixtral"

- Model identifier: bedrock/

model-identifieraus der unterstützten Liste

- Create self-hosted model auswählen

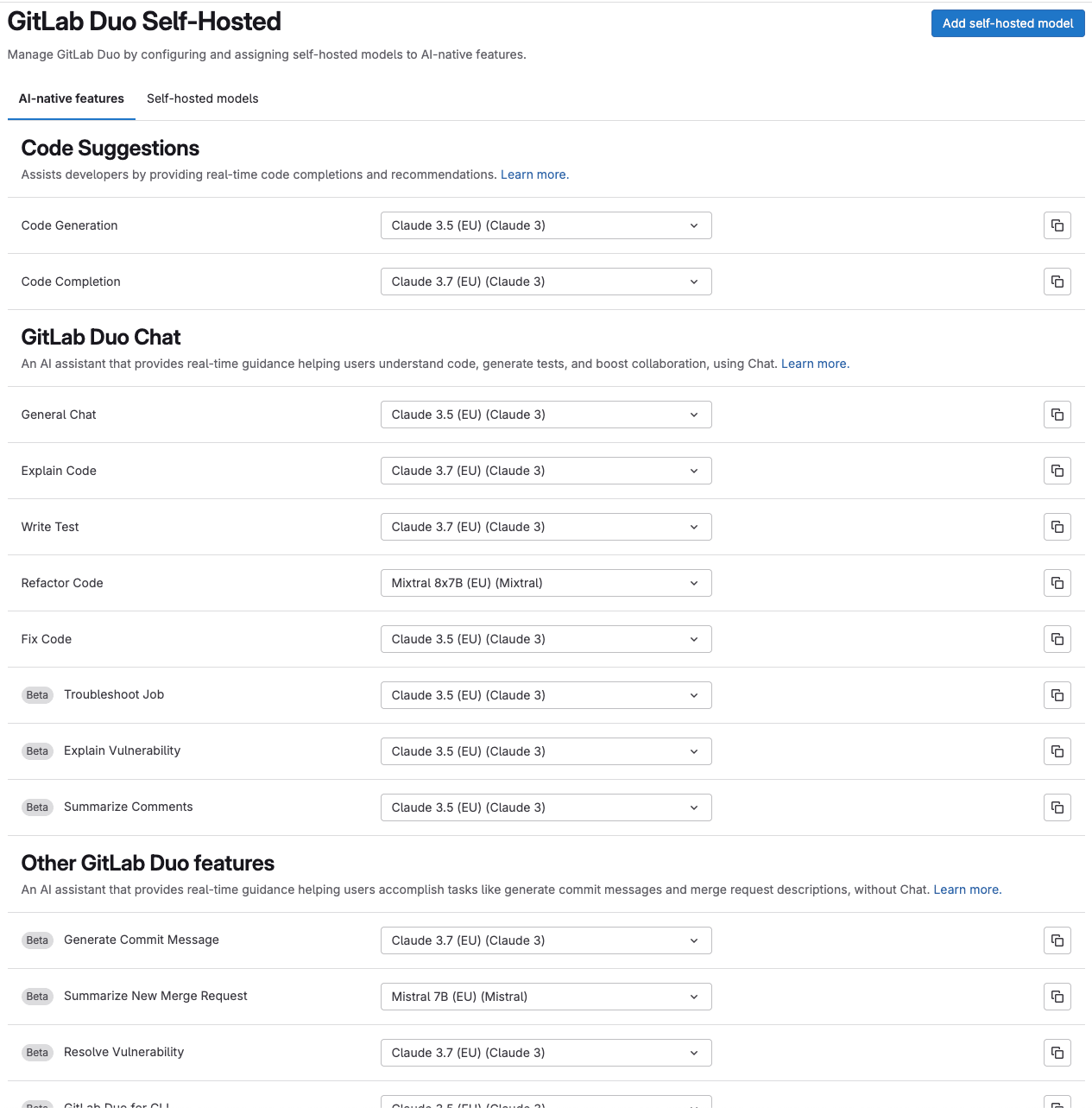

5. GitLab Duo-Funktionen für Self-Hosted-Modell konfigurieren

Nach Konfiguration des Modells lässt es sich spezifischen GitLab Duo-Funktionen zuweisen:

- In der linken Seitenleiste unten Admin auswählen

- GitLab Duo Self-Hosted auswählen

- Tab AI-powered features auswählen

- Für jede Funktion (beispielsweise Code Suggestions, GitLab Duo Chat) und Unterfunktion (beispielsweise Code Generation, Explain Code) das gerade konfigurierte Modell aus dem Dropdown-Menü auswählen

Beispielsweise lässt sich Mixtral 8x7B für Code Generation-Aufgaben und Claude 3 Sonnet für die GitLab Duo Chat-Funktion zuweisen. Die Anforderungsdokumentation hilft bei der Auswahl des richtigen Modells für den Anwendungsfall aus der Modellkompatibilitätsliste pro Duo-Funktion.

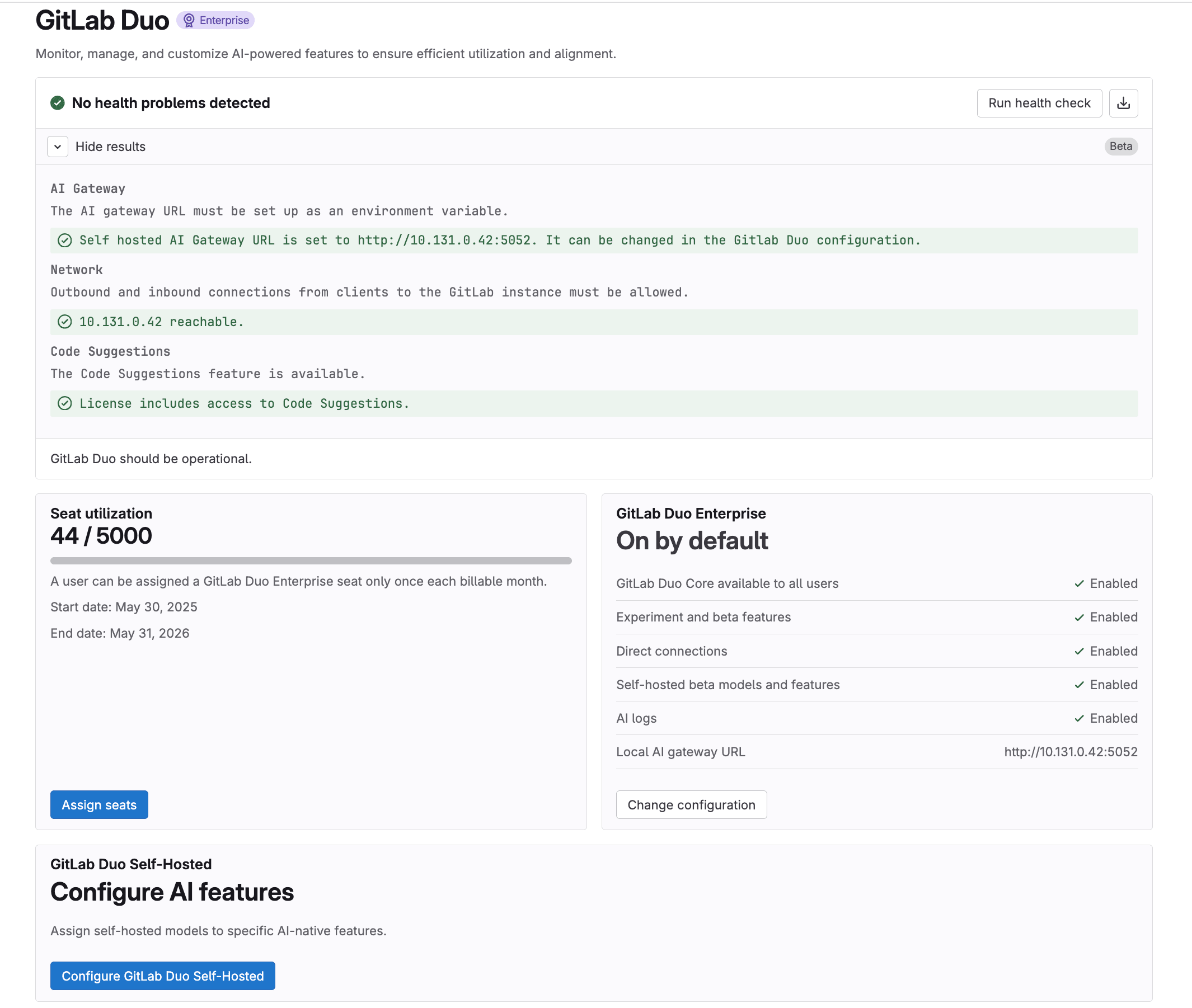

Setup verifizieren

Zur Sicherstellung, dass die GitLab Duo Self-Hosted-Implementierung mit AWS Bedrock korrekt funktioniert, diese Verifikationsschritte durchführen: 1. Health-Check durchführen Nach Ausführung des Health-Checks des Modells zum GitLab Duo-Bereich in der Admin-Seite zurückkehren und Run health check anklicken. Dies verifiziert:

- AI Gateway-URL ist korrekt konfiguriert

- Die Instanz kann sich mit dem AI Gateway verbinden

- Die Duo-Lizenz ist aktiviert

- Ein Modell ist Code Suggestions zugewiesen – da dieses Modell zum Testen der Verbindung verwendet wird

Bei Problemen im Health-Check die Troubleshooting-Anleitung für häufige Fehler konsultieren.

2. GitLab Duo-Funktionen testen Einige GitLab Duo-Funktionen ausprobieren:

- In der Benutzeroberfläche GitLab Duo Chat öffnen und eine Frage stellen

- Die Web-IDE öffnen

- Neue Code-Datei erstellen und prüfen, ob Code Suggestions erscheint

- Code-Snippet auswählen und

/explain-Befehl verwenden, um eine Erklärung von Duo Chat zu erhalten

3. AI Gateway-Logs prüfen AI Gateway-Logs prüfen, um Anfragen vom ausgewählten Modell zu sehen: Im Terminal ausführen:

docker logs <ai-gateway-container-id>

Optional: In AWS lassen sich CloudWatch und S3 als Log-Ziele aktivieren. Dies ermöglicht das Anzeigen aller Anfragen, Prompts und Antworten in CloudWatch. Warnung: Die Aktivierung dieser Logs in AWS protokolliert Nutzerdaten, was möglicherweise nicht mit Datenschutzregeln vereinbar ist. Damit steht vollständiger Zugriff auf GitLab Duos KI-Funktionen plattformweit zur Verfügung – bei vollständiger Kontrolle über den Datenfluss in der abgesicherten Umgebung.

Nächste Schritte

Das richtige Modell für jeden Anwendungsfall auswählen

Das GitLab-Team testet systematisch die Leistung jedes Modells für jede Funktion und stellt Tier-Rankings für Modellleistung und Eignung je nach Funktionalität bereit:

- Vollständig kompatibel: Das Modell kann die Funktion voraussichtlich ohne Qualitätsverlust handhaben

- Weitgehend kompatibel: Das Modell unterstützt die Funktion, jedoch mit möglichen Kompromissen oder Einschränkungen

- Nicht kompatibel: Das Modell ist für die Funktion ungeeignet und führt wahrscheinlich zu signifikantem Qualitätsverlust oder Leistungsproblemen Zum Zeitpunkt der Veröffentlichung lassen sich die meisten GitLab Duo-Funktionen mit Self-Hosted konfigurieren. Die vollständige Verfügbarkeitsübersicht findet sich in der Dokumentation.

Über AWS Bedrock hinaus

Während sich dieser Leitfaden auf AWS Bedrock-Integration konzentriert, unterstützt GitLab Duo Self-Hosted mehrere Bereitstellungsoptionen:

- On-Premises mit vLLM: Modelle lokal mit vLLM für vollständig luftspalt-isolierte Umgebungen betreiben

- Azure OpenAI Service: Ähnlich wie AWS Bedrock lässt sich Azure OpenAI für Modelle wie GPT-4 verwenden

Zusammenfassung

GitLab Duo Self-Hosted bietet eine umfassende Lösung für Unternehmen, die KI-gestützte Entwicklungswerkzeuge benötigen und gleichzeitig strikte Kontrolle über Daten und Infrastruktur wahren. Durch Befolgen dieses Implementierungsleitfadens lässt sich eine robuste Lösung bereitstellen, die Sicherheits- und Compliance-Anforderungen unterstützt – ohne Kompromisse bei den erweiterten Fähigkeiten, die KI in den Software-Entwicklungszyklus einbringt. Für Unternehmen mit strengen Sicherheits- und Compliance-Anforderungen ermöglicht GitLab Duo Self-Hosted die Nutzung von KI-Fähigkeiten bei gleichzeitiger Absicherung von Code und geistigem Eigentum innerhalb der eigenen Grenzen. Weitere Informationen zur Implementierung von GitLab Duo Self-Hosted: GitLab-Vertrieb kontaktieren oder Dokumentation besuchen.